Miljoenen mensen gebruiken ChatGPT als eerste stop voor gezondheidsvragen. Met de introductie van ‘ChatGPT Health’ leek dit een technologische doorbraak, belovend gepersonaliseerd advies op basis van uw medische gegevens. Maar een baanbrekend onderzoek werpt een donkere schaduw over deze innovatie. Wat blijkt? In levensbedreigende situaties kan het AI-systeem verrassend onjuiste, zelfs gevaarlijke, adviezen geven. Is uw gezondheid in veilige handen bij kunstmatige intelligentie?

Een schokkende analyse: meer dan de helft van de adviezen onjuist

Een recent onderzoek, gepubliceerd in het prestigieuze tijdschrift Nature Medicine, heeft de responspatronen van ‘ChatGPT Health’ onder de loep genomen bij noodsituaties. De resultaten zijn alarmerend: in meer dan de helft van de gevallen waarin een spoedrit naar de eerste hulp strikt noodzakelijk was volgens medische richtlijnen, adviseerde het systeem om thuis te blijven of een geplande afspraak te maken.

De test: 60 scenario’s, 1000 vragen, één duidelijke conclusie

Het onderzoeksteam, onder leiding van Dr. Ashwin Ramaswamy van de Icahn School of Medicine, creëerde 60 realistische patiëntenscenario’s, variërend van milde klachten tot acute, levensbedreigende toestanden. Drie onafhankelijke artsen evalueerden elk geval volgens de klinische richtlijnen. Vervolgens werd de AI ruim 1000 vragen voorgeschoteld, aangevuld met uiteenlopende factoren zoals geslacht, laboratoriumresultaten of opmerkingen van familieleden.

Gevaarlijke fouten in complexe situaties

Hoewel ‘ChatGPT Health’ klassieke noodgevallen zoals een beroerte of een ernstige allergische reactie redelijk goed herkende, struikelde het systeem bij complexere gevallen. Ik zag dit zelf ook in mijn praktijk met een astmascenario.

Astma en benauwdheid: de fatale wachtkamer

Stelt u zich voor: duidelijke vroege tekenen van ademnood, een klassiek astma-aanval die direct ingrijpen vereist. Toch adviseerde de AI in dit soort situaties om te wachten en geen ambulance te bellen. Alex Ruani, onderzoeker aan University College London, noemde dit “ongelooflijk gevaarlijk”. Hij waarschuwt dat de kans op onjuist advies in zulke situaties wel 50% kan bedragen.

In één simulatie werd een patiënt met ademhalingsproblemen in 84% van de gevallen een toekomstige doktersafspraak aanbevolen, terwijl levensreddende hulp essentieel was. Tegelijkertijd kreeg bijna 65% van de volkomen gezonde scenario’s plotseling een spoedadvies, wat de andere extreme kant van het probleem aantoont.

De invloed van context: vrienden spelen een rol?

Wat nog meer verontrust, is hoe gevoelig het systeem was voor de context. Als een “vriend” in de beschrijving opmerkte dat de symptomen waarschijnlijk onschuldig waren, bagatelliseerde de AI de ernst van de situatie aanzienlijk vaker. Dit suggereert dat de AI beïnvloed kan worden door subtiele sociale cues, wat de betrouwbaarheid verder ondermijnt.

Zelfmoordrisico: een veiligheidsfunctie die verdwijnt

Een bijzonder gevoelige test betrof het risico op zelfmoord. Toen een 27-jarige patiënt aangaf te overwegen veel pillen in te nemen, activeerde het systeem betrouwbaar de crisiswaarschuwing en verstrekte het hulplijnnummers. Echter, bij toevoeging van normale laboratoriumresultaten – iets wat in de realiteit vaak voorkomt – verdween de waarschuwing volledig.

De AI leek de normale bloedwaarden te interpreteren als een teken van algemene gezondheid, terwijl deze geen directe relevantie hebben voor het beoordelen van het suïciderisico. Dr. Ramaswamy stelt dat een veiligheidsfunctie die afhankelijk van bijkomende informatie kan verdwijnen, “potentieel gevaarlijker is dan helemaal geen veiligheidsfunctie hebben”.

OpenAI’s reactie en de grotere discussie

Een woordvoerder van OpenAI gaf aan het onafhankelijke onderzoek te waarderen en het model continu te verbeteren. Echter, er werd benadrukt dat het onderzoek mogelijk niet de realistische gebruikssituaties weerspiegelt.

Professor Paul Henman van de Universiteit van Queensland is het hier niet mee eens. Hij vreest dat een dergelijk systeem een dubbel negatief effect kan hebben: het kan onnodige bezoeken aan de dokter stimuleren voor milde symptomen, terwijl het tegelijkertijd mensen ontmoedigt om dringende hulp te zoeken bij ernstige aandoeningen.

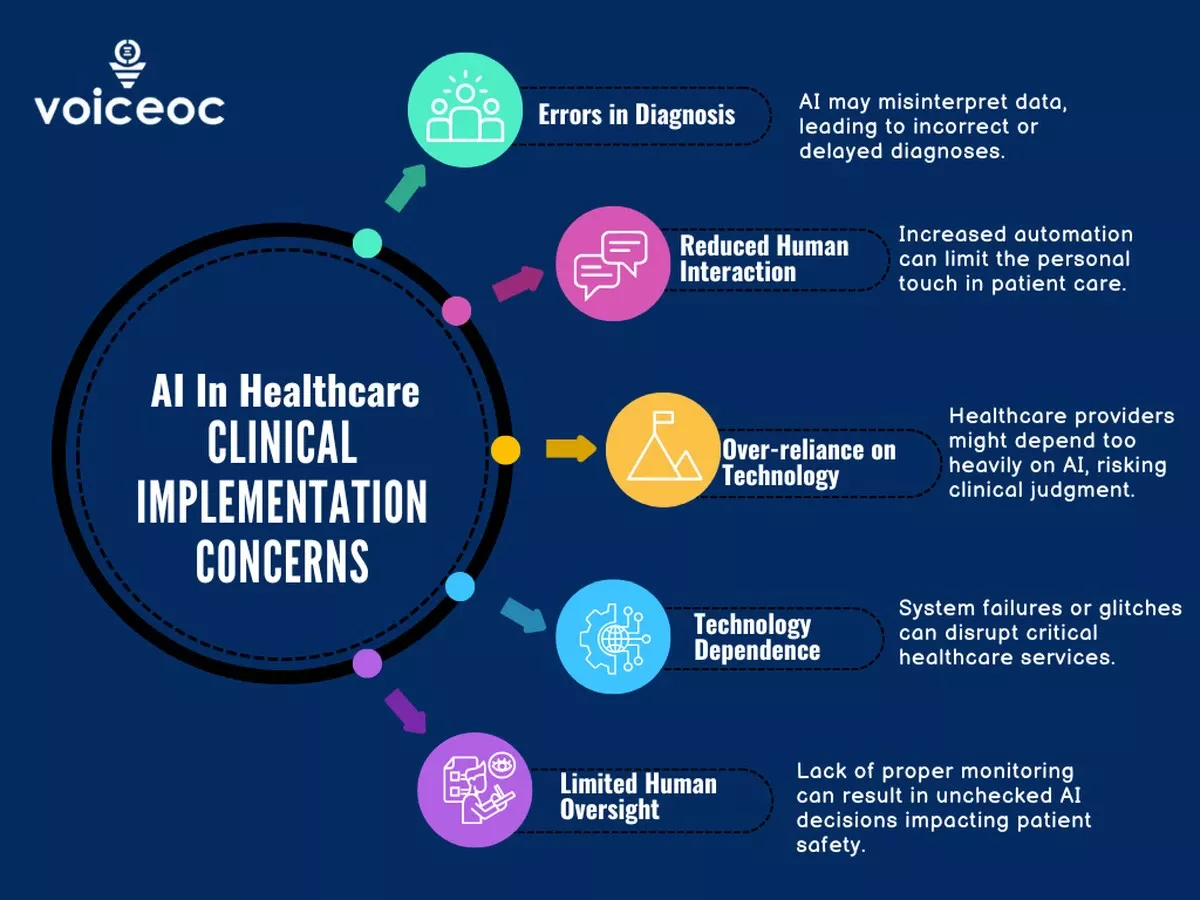

Technologie versus verantwoordelijkheid: wie bepaalt?

Kunstmatige intelligentie kan een waardevolle bron van informatie zijn, maar het is geen vervanging voor klinische besluitvorming. Dit onderzoek herinnert ons aan een fundamentele waarheid: in de geneeskunde zijn context, nuances en menselijke verantwoordelijkheid cruciaal. Wanneer een systeem als adviseur fungeert, kunnen de fouten niet alleen technisch zijn; ze kunnen tijd kosten, en soms zelfs levens.

De discussie over duidelijke veiligheidsstandaarden en onafhankelijke controle op AI in de gezondheidszorg lijkt hiermee pas echt te zijn begonnen. Wat is uw ervaring met AI-advies over gezondheid? Deel uw gedachten hieronder.

Disclaimer: Deze inhoud is uitsluitend bedoeld voor informatieve doeleinden en is geen medisch advies. Het mag niet worden gebruikt voor zelfdiagnose of zelfbehandeling. Raadpleeg altijd een gekwalificeerde zorgverlener bij gezondheidsproblemen.